CVPR 2023!F2-NeRF:几分钟内可合成任意视角的Nerf模型

作者:小张Tt | 来源:3DCV

在公众号「3DCV」后台,回复「原论文」可获取论文pdf和代码链接

添加微信:dddvisiona,备注:三维重建,拉你入群。文末附行业细分群

本文介绍了一种新颖的基于网格的NeRF(神经辐射场)模型,命名为F2NeRF(Fast-Free-NeRF),用于新视角合成。该模型能够处理任意输入的相机轨迹,并且只需要几分钟进行训练。现有的快速网格化NeRF训练框架,如Instant-NGP、Plenoxels、DVGO或TensoRF,主要设计用于有界场景,并依赖于空间扭曲来处理无界场景。已有的两种广泛使用的空间扭曲方法仅设计用于前向轨迹或360°对象中心轨迹,但无法处理任意轨迹。本文深入研究了空间扭曲处理无界场景的机制。根据作者的分析,作者进一步提出了一种新颖的空间扭曲方法,称为透视扭曲(perspective warping),允许在基于网格的NeRF框架中处理任意轨迹。大量实验证明,F2-NeRF能够使用相同的透视扭曲方法在两个标准数据集和作者收集的新的自由轨迹数据集上渲染出高质量的图像。

读者理解:

本文提出很有创新性和实用性。本文提出了一种基于网格的NeRF模型,叫做F2-NeRF,可以用任意的相机轨迹来合成新的视角,而且训练时间只需要几分钟。它还提出了一种新的空间变形方法,叫做透视变形,可以处理无界的场景。它在两个标准数据集和一个自己收集的自由轨迹数据集上进行了大量的实验,证明了它的效果和效率。它的主要贡献有:

F2-NeRF模型:它是一个基于网格的NeRF模型,可以用任意的相机轨迹来合成新的视角,而且训练时间只需要几分钟。它利用了一种高效的采样策略和一种梯度缩放的技巧,提高了渲染质量和速度。

透视变形方法:它是一种新的空间变形方法,可以处理无界的场景。它根据相机的位置和方向,将网格沿着视线方向进行拉伸或压缩,使得网格能够覆盖更多的场景空间,避免了空洞和失真的问题。

自由轨迹数据集:它是一个自己收集的自由轨迹数据集,包含了不同的场景和相机运动。它用于测试F2-NeRF模型在任意轨迹下的表现,以及和其他基于网格的NeRF模型的比较。

1 引言

本文介绍了F2-NeRF,这是第一个能够在大型无界场景中适应自由相机轨迹的快速NeRF训练方法。在现有基于网格的方法的基础上,F2NeRF采用透视扭曲的通用空间扭曲方案,允许处理任意相机轨迹。透视扭曲通过将3D点的投影的2D坐标映射到紧凑的3D子空间,是对现有NDC扭曲和反球体扭曲的泛化。为了在基于网格的NeRF框架中实现透视扭曲,文中提出了一种自适应的空间细分算法,以有效地利用粗网格和细网格来表示背景和前景区域。大量实验证明,F2-NeRF在无界前向、无界360°对象中心和新的无界自由轨迹数据集上使用相同的透视扭曲渲染出高质量的图像,且在自由轨迹数据集上的性能优于基线基于网格的NeRF方法,且仅需约12分钟的2080Ti GPU训练时间。在这里推荐工坊课程基于深度学习的三维重建MVSNet系列论文+源码+应用+科研

2 相关工作

本文涉及新视角合成(NVS)和神经场景表示领域的相关工作。在NVS方面,研究主要集中在利用光图和光场函数直接插值输入图像,以及通过3D重建提高合成图像质量。F2-NeRF致力于通过神经表示解决NVS任务。在神经场景表示方面,以NeRF为代表的方法被广泛用于新视角合成、重新照明、场景泛化、形状表示和多视图重建等任务。F2-NeRF采用了细分场景和混合神经场景表示以实现快速训练和高质量渲染。此外,本文还讨论了基于网格的NeRF训练方法,指出了空间扭曲的问题,并提出了透视扭曲来处理任意相机轨迹。最后,指出F2-NeRF适用于小规模场景,有望成为大规模NeRF中的重要组成部分。

3 方法

本文提出了一种名为F2-NeRF的方法,旨在解决在未界定场景中进行新视角合成任务的问题。以下是本文采用的主要方法:

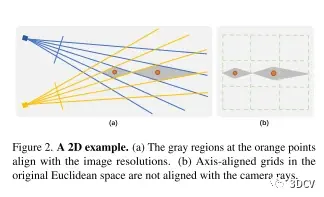

空间扭曲函数 F(x):为了在无界场景中构建基于网格的神经表示,引入了空间扭曲函数 F(x),将无界空间映射到有界区域。透过透视扭曲,该方法能够将相机射线上采样的点映射到扭曲空间。

透视扭曲函数构建(Perspective Warping):通过对透视扭曲函数的详细构建,作者通过引入问题1,使用了主成分分析(PCA)方法,构建了一个近似的合适的三维透视扭曲函数 F(x)。该函数将原始三维空间映射到一个以原点为中心的扭曲空间,提供了一种有效的场景表示。

空间细分:为了在透视扭曲中有效应用 F(x),引入了自适应的空间细分策略。使用八叉树数据结构,将空间划分为不同的区域,使得每个区域都有一个相应的透视扭曲函数。这样,相同区域内的可见相机相同,而不同区域则具有不同的可见相机。

场景表示:为了避免参数数量过多,作者采用了一种基于哈希网格的方法,使用多个哈希函数在扭曲空间上建立了表示。这种方法有效地减少了参数数量,同时能够处理不同区域的场景表示。

透视采样和渲染:使用透视扭曲函数提供的指导,进行了透视采样,通过体积渲染框架生成像素颜色。在渲染阶段,采样的密度和颜色从多分辨率哈希网格中获取。

训练过程:文中定义了训练损失,包括颜色重建损失、视差损失和总变差损失。这些损失用于训练模型,使其能够准确地重建颜色、限制视差,并在相邻八叉树节点之间保持一致的密度和颜色。

总体而言,F2-NeRF方法通过引入透视扭曲函数和自适应的空间细分策略,以及基于哈希网格的场景表示方法,有效地解决了在未界定场景中进行新视角合成的问题。

4 实验

本研究旨在解决未界定场景下的新视角合成任务,使用了一种名为F2-NeRF的方法进行实验评估。主要内容包括:

实验设置:使用三个数据集进行评估:自采集的自由轨迹数据集、LLFF数据集和NeRF-360-V2数据集。采用PSNR、SSIM和LPIPSVGG三个指标进行评估。比较了F2-NeRF与现有快速NeRF训练方法以及其他基线模型的性能。

比较研究:在自由数据集上,F2-NeRF在渲染质量上表现最优。定性比较显示,DVGO和Plenoxels的合成图像模糊不清,而Instant-NGP的结果虽然锐利但场景空间组织不平衡。相比之下,F2-NeRF利用透视扭曲和自适应空间细分充分发挥了表示能力,生成了更好的渲染质量。

消融研究:在“pillar”数据上进行了消融研究。使用多分辨率哈希网格作为场景表示,变换扭曲函数和采样策略进行实验。结果表明,使用透视扭曲和透视采样的模型性能最佳,显示出透视扭曲在自由轨迹数据集上的有效性。

研究表明,F2-NeRF方法在自由轨迹下具有良好的渲染质量,在透视扭曲和空间细分策略上取得了显著效果,为未界定场景下的新视角合成任务提供了新的有效解决方案。

5 总结

在未界定场景的新视角合成任务中,先前的NeRF方法主要依赖于NDC扭曲或逆球面扭曲来处理前向相机轨迹或360度对象中心轨迹。本文对空间扭曲函数进行了深入分析,并提出了一种新颖的透视扭曲方法,能够处理任意输入相机轨迹。基于透视扭曲,作者在基于网格的NeRF框架中开发了一种新的F2-NeRF方法。大量实验证明,所提出的F2-NeRF能够在仅需数分钟的训练时间内渲染出高质量的图像,且适用于任意轨迹。