03-04-nn网络层-池化-线性-激活函数层.mp4

池化层/线性层/激活函数层

池化运算是对信号进行(收集、总结、压缩)

nn.MaxPool2d最大池化

此参数在反池化的时候,把参数放到对应位置

nn.AvgPool2d平均池化

这两个参数需要注意,在平均值相加后,除以除法因子代替除以像素个数(若激活)

反池化 上采样

nn.MaxUnpool2d 最大值反池化

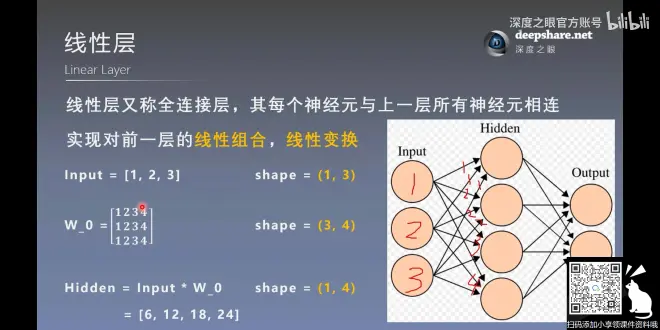

线性层、全连接层

相乘再相加,此处偏置bias=0,W为权值矩阵

nn.Linear 一维信号线性组合

激活函数层

在神经网络中,会使用多个全连接层进行叠加。例如Alex net在输出分类会使用多个全连接层进行叠加。

在每个全连接层输出的时候,通常会添加一个非线性的激活函数,非线性的激活函数赋予了多层神经网络具有深度的意义!!!

如果没有非线性的激活函数,无论多少个全连接层进行连接,都等价于一层的网络,原因是矩阵的结合性,如下图所示

多个权值矩阵相乘等价于一个权值矩阵,故等价于一层线性层网络

nn.sigmoid 用于二分类

nn.tanh 双曲正切函数

nn.ReLU 修正线性单元