37 微调【动手学深度学习v2】

微调:深度学习中最重要的一个技术

通常情况下,要获得一个足够数量的数据集的成本是很大的。我们希望只需要教给人工智能不多的东西,它就能自动联想并达到较好的效果。

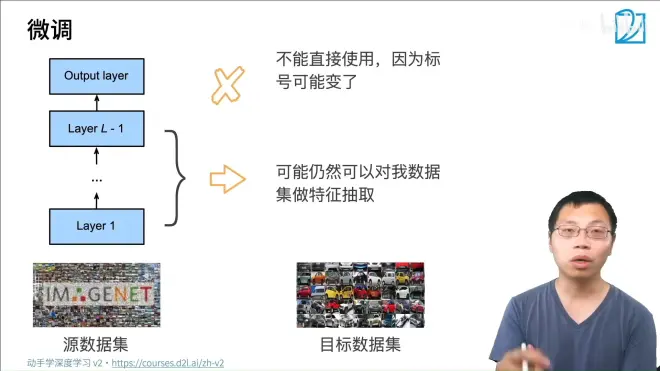

对于一个已经被某数据集进行良好训练过的网络来说,用它来识别新数据集也是可行的。

但是线性回归层要根据需要区别的类别数进行一定的更改。

微调初始化:

特征提取层初始化:照搬源网络

线性分类层:随机初始化

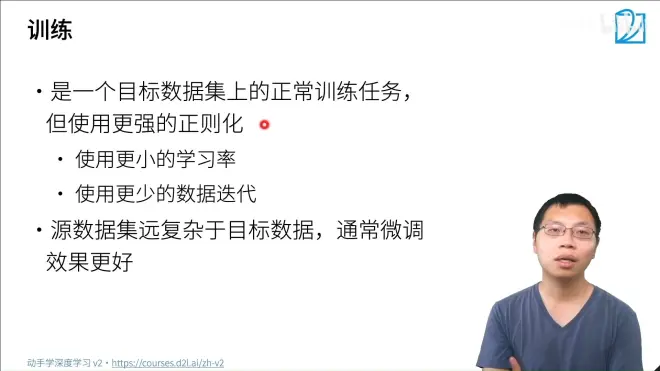

在微调中,主要的目的是训练出符合新功能需求的线性分类层,所以只要较小的学习率和较少的数据迭代就可以了。

在源数据集复杂度远大于目标数据集时,微调效果更好,若两数据集复杂度相近,则建议重新训练新的网络。

微调常用技术:

·若源数据集里已经包含目标数据集中的部分分类类别,可以将源数据集的线性分类层中的对应标号参数作为目标数据集线性分类层的对应标号初始化值。

·固定层法

代码实现

import os

import torch

import torchvision

from torch import nn

from d2l import torch as d2l

d2l.DATA_HUB['hotdog'] = (d2l.DATA_URL + 'hotdog.zip',

'fba480ffa8aa7e0febbb511d181409f899b9baa5')

data_dir = d2l.download_extract('hotdog')

创建两个实例来分别读取训练和测试数据集中的所有图像文件。

train_imgs = torchvision.datasets.ImageFolder(os.path.join(data_dir, 'train')) test_imgs = torchvision.datasets.ImageFolder(os.path.join(data_dir, 'test'))

下面显示了前8个正类样本图片和最后8张负类样本图片。正如所看到的,图像的大小和纵横比各有不同。

hotdogs = [train_imgs[i][0] for i in range(8)] not_hotdogs = [train_imgs[-i - 1][0] for i in range(8)] d2l.show_images(hotdogs + not_hotdogs, 2, 8, scale=1.4);

在训练期间,我们首先从图像中裁切随机大小和随机长宽比的区域,然后将该区域缩放为224×224输入图像。 在测试过程中,我们将图像的高度和宽度都缩放到256像素,然后裁剪中央224×224区域作为输入。 此外,对于RGB(红、绿和蓝)颜色通道,我们分别标准化每个通道。 具体而言,该通道的每个值减去该通道的平均值,然后将结果除以该通道的标准差。

# 使用RGB通道的均值和标准差,以标准化每个通道左边是RGB通道的mean,右边是RGB通道的std(因为imagenet做了这样的标准化,)

normalize = torchvision.transforms.Normalize(

[0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

train_augs = torchvision.transforms.Compose([

torchvision.transforms.RandomResizedCrop(224),

torchvision.transforms.RandomHorizontalFlip(),

torchvision.transforms.ToTensor(),

normalize])

test_augs = torchvision.transforms.Compose([

torchvision.transforms.Resize([256, 256]),

torchvision.transforms.CenterCrop(224),

torchvision.transforms.ToTensor(),

normalize])

使用在ImageNet数据集上预训练的ResNet-18作为源模型。 在这里,我们指定pretrained=True以自动下载预训练的模型参数。 如果首次使用此模型,则需要连接互联网才能下载。

pretrained_net = torchvision.models.resnet18(pretrained=True)

预训练的源模型实例包含许多特征层和一个输出层fc。 此划分的主要目的是促进对除输出层以外所有层的模型参数进行微调。 下面给出了源模型的成员变量fc,。

pretrained_net.fc

这个输出展示了源网络中分类层的结构

Linear(in_features=512, out_features=1000, bias=True)

在ResNet的全局平均汇聚层后,全连接层转换为ImageNet数据集的1000个类输出。 之后,我们构建一个新的神经网络作为目标模型。 它的定义方式与预训练源模型的定义方式相同,只是最终层中的输出数量被设置为目标数据集中的类数(而不是1000个)。

在下面的代码中,目标模型finetune_net中成员变量features的参数被初始化为源模型相应层的模型参数。 由于模型参数是在ImageNet数据集上预训练的,并且足够好,因此通常只需要较小的学习率即可微调这些参数。

成员变量output的参数是随机初始化的,通常需要更高的学习率才能从头开始训练。 假设Trainer实例中的学习率为r,我们将成员变量output中参数的学习率设置为10r。

finetune_net = torchvision.models.resnet18(pretrained=True) finetune_net.fc = nn.Linear(finetune_net.fc.in_features, 2) nn.init.xavier_uniform_(finetune_net.fc.weight);

定义了一个训练函数train_fine_tuning,该函数使用微调,因此可以多次调用。

# 如果param_group=True,输出层中的模型参数将使用十倍的学习率,

def train_fine_tuning(net, learning_rate, batch_size=128, num_epochs=5,

param_group=True):

train_iter = torch.utils.data.DataLoader(torchvision.datasets.ImageFolder(

os.path.join(data_dir, 'train'), transform=train_augs),

batch_size=batch_size, shuffle=True)

test_iter = torch.utils.data.DataLoader(torchvision.datasets.ImageFolder(

os.path.join(data_dir, 'test'), transform=test_augs),

batch_size=batch_size)

devices = d2l.try_all_gpus()

loss = nn.CrossEntropyLoss(reduction="none")

if param_group:

params_1x = [param for name, param in net.named_parameters()

if name not in ["fc.weight", "fc.bias"]]

trainer = torch.optim.SGD([{'params': params_1x},

{'params': net.fc.parameters(),

'lr': learning_rate * 10}],

lr=learning_rate, weight_decay=0.001)

else:

trainer = torch.optim.SGD(net.parameters(), lr=learning_rate,

weight_decay=0.001)

d2l.train_ch13(net, train_iter, test_iter, loss, trainer, num_epochs,

devices)

使用较小的学习率,通过微调预训练获得的模型参数。

train_fine_tuning(finetune_net, 5e-5)

loss 0.177, train acc 0.932, test acc 0.943 968.4 examples/sec on [device(type='cuda', index=0), device(type='cuda', index=1)]

知识补充:

微调意味着神经网络在进行不同的目标检测时,前面层的网络进行的特征提取是通用的,且越前层越通用。

当目标数据集和源数据集的内容种类相差过大(比如识别癌细胞图片,与日常图片的imagenet差别较大)时,微调的效果可能不好

目标与源数据集差不多,并且可能出现交集或包含,微调 效果可能好很多

微调属于一种迁移学习算法。

基于大规模数据集训练出的源模型是一种财产,被大公司所保密。但基于imgnet训练的模型用于学术研究还是够用的。

在微调中,为了归一化保持一致非常重要。在本节代码中的normalize里的参数是根据imgnet计算出来的

常用的CV预训练模型:ResNet18