Embeddings | LoRa | Hypernetwork概念简析,懂了才

第六课:AI绘画进阶模型

*喜欢的话可以一键三连

笔记下载看这篇专栏CV25267334

一、文本嵌入(Embeddings)

(一)作用:指向某一种特定的形象,除了能帮AI更好地画好字典里已经有的东西以外,有时候也可以帮我们实现特定形象的呈现

如:用于去除特定的不想要的画面(手部错乱等)

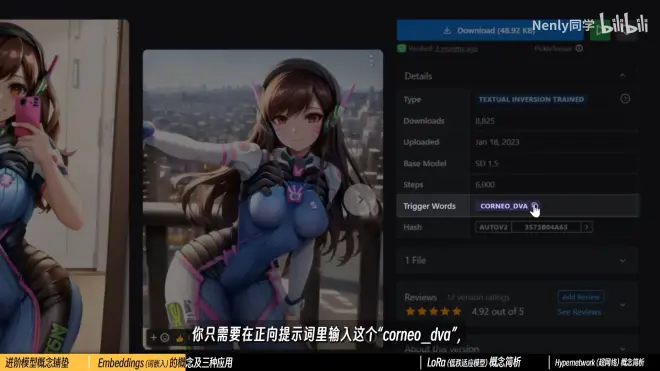

在C站一些模型网站上是另一种形式表述:Textual Inversion - “文本倒置"

(二)特点:文件占用空间非常小,小到可能只有kb,原因在于不包含信息,只是一个标记。

就像大字典(Checkpoint)里面的一个小“书签”,能够精准的为你指向个别字、词的含义,提供高效的索引

*Embeddings在深度学习领域的全称叫做“嵌入式向量",向量在数学里的含义指一个带有方向、指向性的“量”

(三)解释:

让AI画“猫又”,字典里虽然没有这个偏僻的概念,但AI知道“猫”、“人”、 “妖怪”怎么画。在字典里记有这些概念的夹上一片书签(标记),当提到”猫又“这个词时,把这带有书签的页面的信息汇总在一起,就知道“猫又”是个什么东西了

*猫又,俗称猫妖、猫股,在日本神话中是一种有着两条尾巴的黑猫形象。耳朵大而尖,牙齿为双面锯齿型,是猫妖的一种,据说能直立行走。

(四)用法:

C站上就有很多基于特定动漫角色形象训练的Embeddings

1.位置:Embeddings放置路径:根目录/embeddings

文件后缀一般和vae一样是“ .pt ”

2.使用:Embeddings不需要特别调用,只需要在提示词里用特定的“咒语“去召唤它,一般它们的Model Card里都会标注

3.对比:

不使用Embeddings前:

使用后:

*一个小功能的补充

不知道如何写提示词,可以导入图片通过图生图里面的反推提示词功能反推提示词

DeepBooru和CLIP可以算是两种不同的图像识别算法,DB会更快一些

出来的提示词自己确认无误后加到文生图提示词里面

4.优缺点:

(1)

优点:对于一些更为广泛、容错率更高的形象概念,Embeddings的表现会好很多

缺点:对于角色形象上可能不完全像,也只是让A去按图索骥而已(习惯让LoRa去做)

例如:

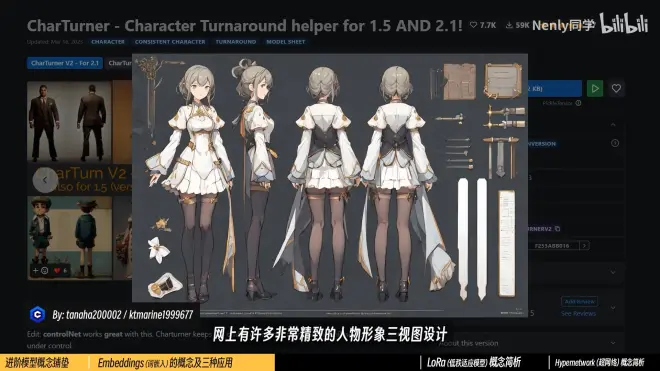

它其实就是把这种几个人物朝向并列的图片结构,作为一种“书签”输入到了AI的字典里

(2)例子的做法:

Embeddings的作者也给出了一个基本的提示词格式

前一个什么什么描述人物本身的特质,后一个着重描写服饰

一些标准化或内容型的提示词可以被保留下来

我还添加了这一系列提示词以及作者提供的一个描述句来固定生成图片的格式

可以同时在一次生成里激活多个Embeddings,它们不至于冲突,但产生的化学反应是需要你自己观察的

记得开启高清修复,能让你的图片变得更加清晰且精致

当然还是有些问题的,比如在人物细节的稳定性以及转身动作的具体幅度上面

上面问题在后面我们接触了ControlNet、 LoRa等更为进阶的操作手法以后,都能得到更好的实现

5.解决肢体问题

(1)Embeddings常常被我们用于解决AI绘画过程中的一个巨大的痛点:AI不会画手(不光手部问题)

因为AI是用扩散的方式来实现图像生成的,对人的正常身体结构并没有一个完整的认知,它只知道人有两只手两只脚,有时候却不知道它们是怎么拼到一起的

(2)Negative Embeddings(负面词嵌入)

①

以EasyNegative为例子,它需要把提示词“EASYNEGATIVE”放到“负面提示词”里面激活

未加前:

加提示词后:

实际上EasyNegative能解决的问题远不止多一只手或少几根手指。

它是一种综合的、全方位的基于负面样本的提炼,解决的问题可能还包括肢体错乱、颜色混杂、噪点和灰度异常等(但不一定100%解决)

②不同的嵌入词会有所区别:

EasyNegative是基于Counterfeit去训练的,作者测试了对大多数二次元模型都有效

DeepNegative则主要是针对真人模型来训练的

二、LoRa(秩适应模型)

(一)作用:

在于帮助你向A传递、描述某一个特征准确、主体清晰的形象(固定特征点)

(二)概念:

让AI画一只“小猪佩奇”,可AI没有接触过这些概念。虽然可以通过很多个书签让它东找西找凑出一个佩奇来,但效果不一定很好

如果说Embeddings是轻薄便利的小书签,LoRa就好像是一张夹在里面的彩页一样,上面把“佩奇”是什么,有什么特点,用什么方式去呈现,全写出来了。这样AI对“佩奇”的理解是更加全面且准确的

(三)位置:根目录/models/Lora

(四)使用与实例:

1.触发LoRA:

在提示词里输入<lora:"LoRA名称">

例:<lora:dVaOverwatch_v3>

一些LoRA也会提供触发提示词(Trigger Word),可以把提示词也加上

出图对比效果:

2.使用过程中的小问题:

因为它的训练图源复杂,所以一般也会对画风构成些微影响

(上面那张图Counterfeit带来的那种水彩涂抹的精致感就弱了一些)

3.解决问题:

可以适当降低LoRa作为一个关键词的权重

0.5~0.8之间都可以确切地保留特征但减弱对画面风格的影响

(LoRa、Embeddings等的提示词权重调整方式与普通提示词一致)

大部分LoRa作者也会给出他们认为合适的LoRa权重,抄作亚的时候还可以参考其他创作者绘制的效果

对比:

(想更加深入了解LoRa,观看第九课)

三、Hypernetwork(超网络)

(一)概念:

超网络的原理与LoRA不同,但最后能实现的效果其实和LoRa是差不多的

说LoRa是传单,可以把Hypernetwork理解成一张小卡片,都差不多

(二)有点小区别:

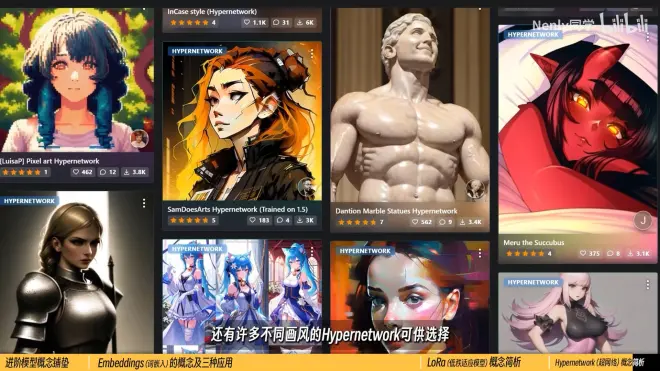

Hypernetwork一般被用于改善生成图像的整体风格,这个画风比Checkpoint所定义的画风要更为精细一些

(三)位置:根目录/models/hypernetwork

(四)例子:

Waven Chibi Style

1.如何使用超网络:

(1)设置—附加网络—将超网络(Hypernetwork)添加到提示词—选择对应的超网络添加到提示词里

(2)另外超网络可以使用类似于Lora的词条模式直接激活

格式为: <hypernet:模型名.pt:0.8(权重)>

(设置完记得点击上面的保存)

2.其他情况:

(1)网上多数研究者对于Hypernetwork在图像生成方面的评价并不好,至少不如LoRa和Embeddings那么好

(2)超网络的作用可以部分被LoRa取代的

(3)在需要实现特定艺术风格时,超网络仍然可以给你提供不少帮助

例如雕塑风格、像素画、抽象画等,推荐你换几个不同的风格多做尝试

四、总结