【渐构】万字科普GPT-4为什么会颠覆人类社会

时间:20230315

up主YJango老师提前说明:

视频是关于GPT的底层原理和未来影响。

将抛开技术细节,少用专业名词,在整体功能上讲解 ChatGPT 的

「工作原理」「制造过程」「涌现的能力」「未来的影响」以及「如何应对」:

1、ChatGPT是如何回答问题的

2、它是怎么被制造的,为什么它不是搜索引擎

3、它有哪些惊人能力,为什么它不只是聊天机器人

4、它将给社会带来什么样的冲击

5、我们该如何维持未来的竞争力

视频内容:

2.1实质功能:【单字接龙】

(给定任意长的上文,它会根据自己的模型去生成下一个字)

⭐如何回答长内容的?

——

即:自回归生成

影响因素两个:上文+模型

训练模型,方式是给一份学习材料来做单字接龙,然后不断调整

如果同时训练了两份都是“白日”开头做上文的不同材料——

那么遇到“白日”,生成?

生成的下一个字就是按照概率分布抽样得到的结果

Above,都是说了由上文按照概率分布生成了下文,即做到【补全或续写】,那它是怎么回答问题的?

↓(将二者组合成一个问答范例)

不需要将所有的组合都灌给chatGPT,训练的目的并不是记忆,而是学习

在训练之前,数据库已经将所有信息都记忆好了

非要训练单字接龙——

驱使它建构三个提问的通用规律

经过这种训练,即使它遇到没有记忆过的提问时,也能举一反三,生成它通用模型的内容

训练过程中,学习材料并【没有被保存】在模型中。学习材料的作用是【调整模型】

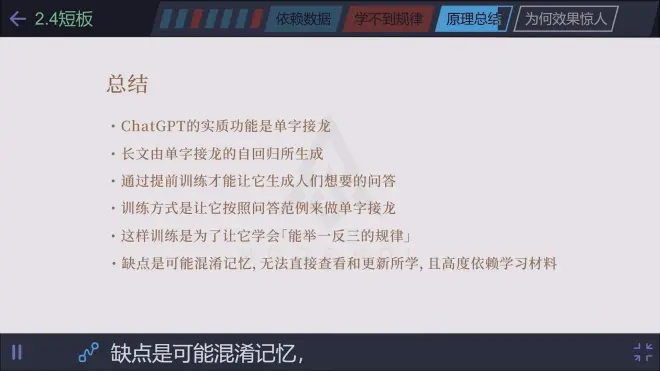

ChatGPT相较搜索引擎的短板:

①搜索引擎不会混淆记忆,它会

②它的内容无法被直接增删改查

无法直接操作→存在隐患,

要不断调整模型训练才能校正它的所记所学→更新时的效率降低

③高度依赖数据(即学习材料)

否则回答会以偏概全或存在胡编混淆

让机器理解人类语言的难点在于——

解决方法↓

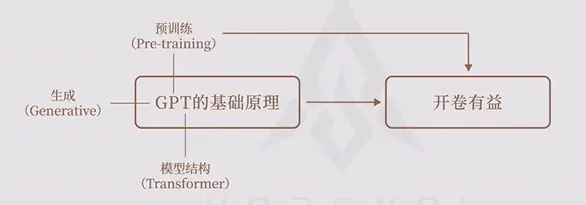

阶段1:开卷有益

P: pre-training,预训练

2018年6月,GPT-1

2019年2月,GPT-2

2020年5月,GPT-3

GPT-1在一些任务的表现上,不如后来的BERT:GPT的学习方式是单字接龙,BERT是完形填空

由此,进入阶段 2

答:

理解例子产生回答↓ 【语境内学习】

由此,进入↓

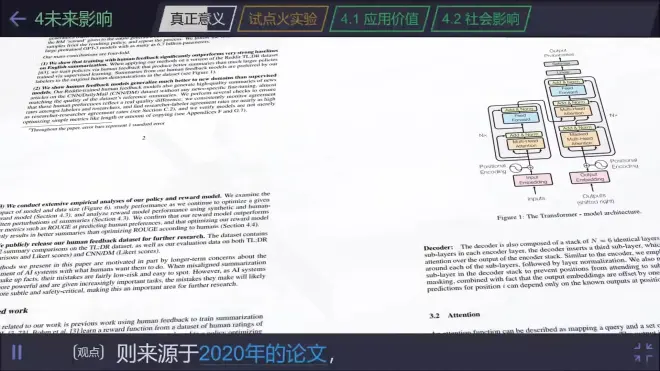

其中的三个阶段的专业称呼是↓

也回答了↓

它相当于试点火试验

我们接下来讨论的焦点:

它不仅精通语言,真正有价值的是,在此基础上,还能存储人类从古至今的世界知识

人类个体的知识会随着个体死亡而断掉,语言的发明让知识可以传承