北大公开课-人工智能基础 59 机器学习的任务之降维

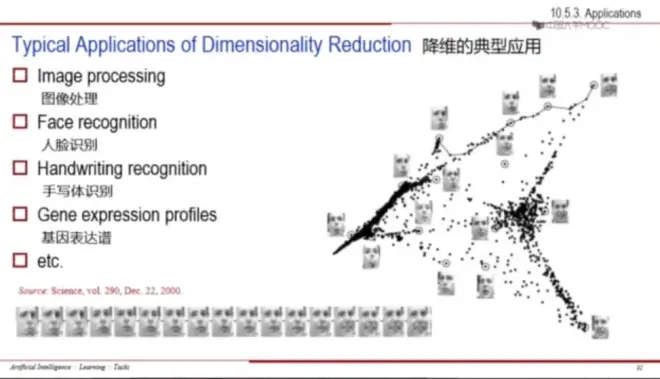

特征降维是机器学习中的一种技术,它可以将高维数据转换为低维数据,以便更好地进行分析和可视化。在机器学习中,特征降维可以帮助我们减少特征数量,从而提高模型的效率和准确性。例如,在图像识别中,我们可以使用特征降维来减少图像中的像素数量,从而使模型更快地处理图像数据。

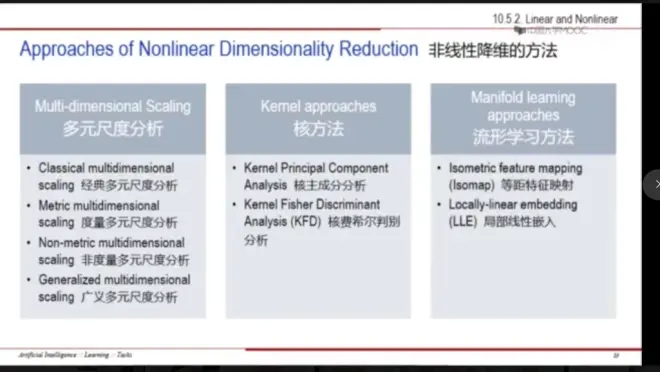

常见的特征降维方法包括主成分分析(PCA)、线性判别分析(LDA)和t-SNE等。这些方法可以帮助我们找到最重要的特征,并将其转换为低维空间中的向量。例如,在PCA中,我们可以使用奇异值分解(SVD)来找到最重要的特征,并将其转换为低维空间中的向量

抓住主要矛盾和主要特征,可视化。

【PCA】

PCA是主成分分析(Principal Component Analysis)的缩写,是一种常见的特征降维方法。它可以将高维数据转换为低维数据,以便更好地进行分析和可视化。在机器学习中,PCA可以帮助我们减少特征数量,从而提高模型的效率和准确性。

PCA的目标是找到数据中最重要的方向,并将其转换为新的坐标系。这些方向被称为主成分,它们是原始特征的线性组合。通过选择最重要的主成分,我们可以将高维数据转换为低维数据,并保留尽可能多的信息。

例如,在图像识别中,我们可以使用PCA来减少图像中的像素数量,并将其转换为更少但更重要的特征。这样可以使模型更快地处理图像数据,并提高模型的准确性。

【LDA】

LDA是线性判别分析(Linear Discriminant Analysis)的缩写,是一种监督学习的降维技术。与PCA不同,LDA考虑了样本的类别信息。它的目标是将高维数据投影到低维空间中,使得同类样本尽可能接近,不同类样本尽可能远离。这样可以提高分类器的准确性。

LDA的核心思想是找到一个投影方向,使得投影后同类样本的方差最小,不同类样本的距离最大。这个过程可以通过求解广义特征值问题来实现。

【PCA和LDA的区别】

【MPCA】

MPCA是多向主元分析(Multilinear principal component analysis)的缩写。它是主成分分析(PCA)到多维的一种扩展。PCA是将投影向量投影到向量,而MPCA是将投影张量投影到张量,投影的结构相对简单,另外运算在较低维度的空间进行,因此处理高维度数据时有低运算量的优势。

MPCA定义一个多重子空间,此子空间提取了大部分正交多维的输入变异量,从而达到特征提取的效果。

【MLDA】

人脸识别中的降维应用

通过降维来降低(图像、人脸这些复杂、高维数据)分类的难度